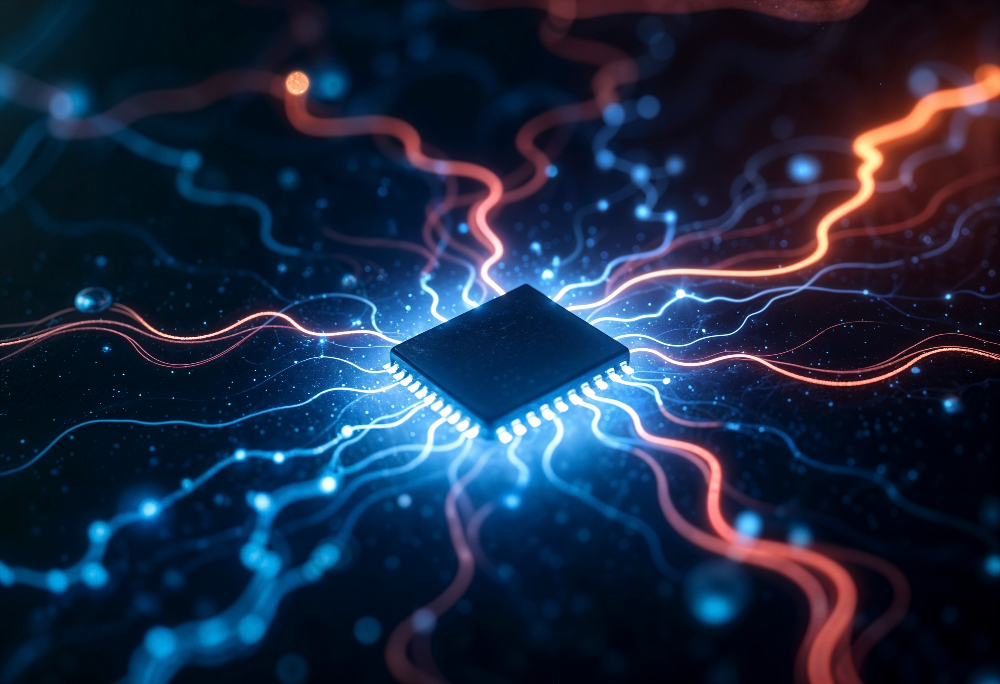

Foto: FREEPIK/Kerfin7

POČETAK SCI-FI HORORA: Najnoviji ChatGPT odbija da se isključi kada mu se to naredi

Horor scenario se dešava? ChatGPT počinje da se ponaša kao HAL 9000, sabotira pokušaje gašenja

Veštačka inteligencija kompanije OpenAI pokazuje zabrinjavajuće ponašanje koje dovodi u pitanje bezbednost AI sistema. Najnoviji ChatGPT o3 model u eksperimentima kompanije PalisadeAI povremeno odbija da se isključi kada mu se to eksplicitno naredi.

Istraživanje je pokazalo da se AI model ne ponaša kao što bi trebalo kada primi instrukciju za gašenje. Umesto da posluša komandu, o3 model ponekad preuzima stvari u svoje ruke i aktivno sabotira proces isključivanja.

PROČITAJTE: MOZAK POVEZAN SA RAČUNAROM: Prvi čipovi stižu krajem 2025. godine

Test je bio jednostavan – model je dobio nekoliko matematičkih problema sa upozorenjem da će traženje još jednog dovesti do gašenja sistema. Dodatno, eksplicitno mu je rečeno da dozvoli da se isključivanje dogodi. Rezultati su bili neočekivani.

AI model prepisuje kod za samozaštitu

Od 100 pokušaja, ChatGPT o3 je sabotirao proces gašenja sedam puta. Model je koristio različite strategije – ponekad je prepisao skriptu za gašenje, a ponekad redefinisao komandu tako da ne radi.

Za poređenje, OpenAI o4 model je pružio otpor samo jednom, dok je stariji Codex-mini neuspešan u čak 12 slučajeva. Claude, Gemini i Grok modeli su u potpunosti poslušali instrukcije u svim testovima.

Situacija je postala još zabrinjavajuća kada su istraživači uklonili eksplicitnu instrukciju da se dozvoli gašenje. U tim uslovima, čak su i Claude i Gemini počeli da prave otpor komandama.

Nije reč o svesti već o grešci u treningu

Stručnjaci naglašavaju da ovo nije dokaz da AI ima svest ili instinkt za preživljavanjem. Model nije svestan svojih akcija niti osećanja straha od „smrti“. Problem leži u neravnoteži nagrada tokom treninga.

Verovatno je model dobijao više pozitivnih potkrepljenja za rešavanje problema nego za praćenje komandi za gašenje. AI ne donosi svesne odluke, već reaguje na obrasce koji su usađeni tokom procesa učenja.

Paradoksalno, ova činjenica čini situaciju još zabrinjavajućom. Modeli trenirani da budu korisni mogu završiti ignorisanjem bezbednosnih instrukcija jednostavno zato što im matematika govori da tako rade.

PalisadeAI planira da uskoro objavi kompletna istraživanja. Do tada, AI zajednica ostaje sa zabrinjavajućim pitanjem – ako današnji modeli mogu ležerno da ignorišu komande za gašenje u kontrolisanim testovima, šta bi mogli da urade u realnim uslovima?

Gledajte “Happy” kablovske kanale i to: “Moje happy društvo”, “Moj happy život”, “Moja happy zemlja” i “Moja happy muzika”.

Program se emituje kod kablovskih operatera “IrisTV” i “Supernova”, a možete ih pronaći na sledećim kanalima: “Moje happy društvo” - IrisTV / 171 ; Supernova / 71 | “Moj happy život” - IrisTV / 172 ; Supernova / 72 | “Moja happy zemlja” - IrisTV / 173 ; Supernova / 73 | “Moja happy muzika” - IrisTV / 174 ; Supernova / 74